过去几个月,OpenAI风头无两,各大科技公司争先恐后地跟进大语言模型(LLM)这一技术路线。

对比之下,OpenAI的老对手DeepMind,显得有些低调和沉默。微软靠OpenAI打了一场胜仗,而谷歌推出的Bard翻了车,和谷歌同属AlphaBeta的DeepMind却没有出来力挽狂澜的意思。

同样是半学术、半企业科研性质的前瞻性AI Lab,DeepMind也瞄准了通用人工智能AGI,但实现路径上,却有着和OpenAI不同的选择。

这段时间我们能看到科技圈在集体“追风口”,大量资源(注意力、算力、人才、政策等)都被投入到OpenAI引领的大语言模型热潮中,有些高校甚至出现了“不做LLM就没有算力用”的局面。“中国没有自己的OpenAI”也被认为是创新滞后的现实证明。

有人说OpenAI的AI属于“精英教育路线”,一路砸钱供它读到博士,一毕业就是王炸,惊艳全场,这点确实没错,也是非常值得很多国内AI Lab学习的。

追逐OpenAI的赛道已经十分拥挤。别忘了,DeepMind默默烧钱、长期锚定的很多研究方向,也非常具有前沿性和想象力,2016年的AlphaGo、2020年的AlphaFold都曾一鸣惊人。下一个“AI王炸”,可能就是DeepMind做出来的。

大家知道有种新闻叫“震惊体”,每一次出现“AI王炸”级产品,就会有大量“震惊体”出现,比如“阿尔法狗要取代人类”“AlphaFold抢了生物学家的工作”“有了ChatGPT人类还有价值吗?”

感到“震惊”,有时真的只是因为知道的太少、太晚,在这些“AI王炸”技术尚在成长阶段,忽视了它们,等能力发展到实用程度,又开始恐慌、焦虑。

届时,我们会不会又会陷入新一轮的追逐跟风,接着抱怨“中国没有自己的DeepMind”呢?

所以,我们不妨来预测一下,DeepMind正在憋的大招里,哪些可能成为下一个王炸,读者们可以有个心理准备,提前对“震惊体”脱敏。

AI要取代科学家,够不够震惊?

ChatGPT走红之后,很多白领人士都担心自己的岗位要被取代了。而科学家可是智力水平站在金字塔顶端的人类,职业生涯肯定稳稳的吧?

AI+科学,正是DeepMind长期锚定的赛道,已经产出了很多突破性的研究成果,覆盖了数学家、物理学家、生物学家的专业领域。

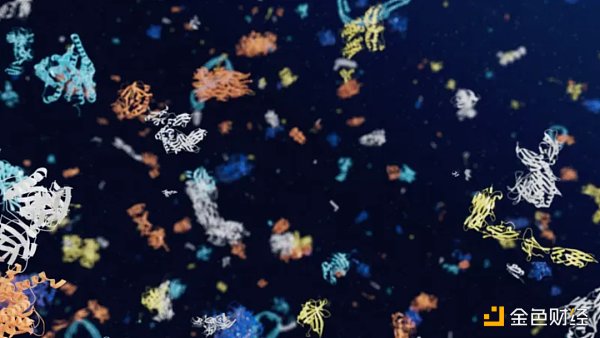

已经问世的AlphaFold和AlphaFold 2就在生物学界掀起了海啸级的影响,彻底改变了蛋白质结构预测的传统方法,也引发了各大高校和科研机构的复现、优化、应用。基于这一新技术,DeepMind一夜之间改变了生物制药行业,也因此成为“数字生物学”这一新兴领域的先驱。

目前,AI+生物学的潜力还没有完全释放出来,AI技术在生物制药和生命科学中的应用,还停留在少数环节中探索、案例级尝试的阶段。DeepMind也正在与行业展开合作,比如与Isomorphic Labs 合作,以“AI-FIRST”原则重构药物发现过程,在著名的生物医学研究中心弗朗西斯·克里克研究所(Francis Crick Institute),建了一个湿实验室,加强AI技术与生物实验的结合,同时还在不断扩大AI for science团队,加快基础生物学的研究。

或许,下一个抗癌新药、生物计算领域的大突破,就会在DeepMind诞生。

(AlphaFold揭示了蛋白质宇宙的结构)

你可能会说,生物学是一门实验科学,有成熟的程式,被AI技术改变很合理。数学、物理这样的基础科学,突破几乎来自天才式的直觉和灵感,有的数学家甚至是在梦中取得突破。比如阿基米德就是在洗澡时灵光一现,发现了浮力定律;拉马努金在梦中发现了3900个公式……AI估计就不好使了吧?

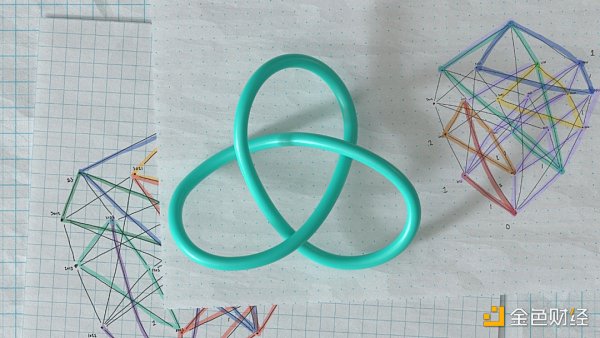

数学、物理,这些涉及抽象世界和人类深层直觉的领域,DeepMind也已经取得了突破。

帮助数学家发现他们从未发现的发现——DeepMind发表在《自然》杂志上的一篇论文显示,研究人员与顶级数学家合作,为一个几十年来都没有结局的数学猜想,通过机器学习(ML)找到了突破口。

使用AI来处理海量或无法直接推理的数据,可以大大增强数学家的洞察力,从而更快地找到证明猜想和新公式的方法,已经被DeepMind证明是可行的。

牛津大学数学系教授Marcus Du Sautoy形容AI技术在纯数学中的应用,“就像伽利略拿起望远镜,能够深入凝视数据宇宙,看到以前从未发现过的东西”。

未来随着探索的增多,很多未被证实的数学猜想,都有可能因AI的加入而突破。希望届时大家不会又以为AI进化出了什么超能力,被“AI取代数学家”之类的标题给骗了。

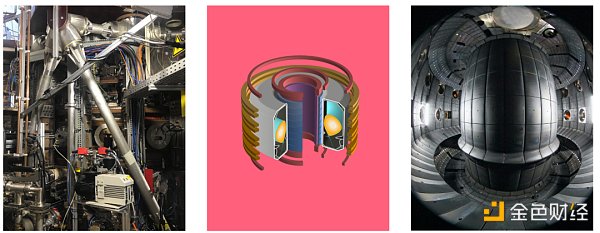

AI参与核聚变的研究进程——核物理无论从学术还是社会政治经济的角度,都是非常重要的。大家可能都听过中国核物理学家造原子弹的艰苦故事,其中很多工作和牺牲能不能由AI来代劳呢?DeepMind还真搞成了。

它们与瑞士等离子体中心,合作开发了一个AI系统,通过强化学习,控制系统可以很好地协调TCV(由许多磁线圈组成),确保等离子体永远不会接触容器壁,这样就可以减少核聚变的热量损失。同时,还能将等离子体精确地雕刻成不同的形状,方便科学家研究等离子体在不同条件下的反应,从而提高对核聚变反应堆的理解。

总之,在过去的几年里,DeepMind在数学、物理、化学、生物学、量子、气象、材料等多个科学领域,创造性地探索了大量AI for science的可能,带来了全新的科学研究方法,必然会催生全新的科学发现和技术突破,下一个“AI王炸”很可能就在其中。

现实版《西部世界》够不够炸裂?

DeepMind的目标也是实现通用人工智能。具体怎么做呢?OpenAI专心搞语言,DeepMind就专注“训狗”——搞强化学习。

弱人工智能,只能在有限的环境中解决特定问题,没有发展出人类身上那种通识智能。那种“通用”智能的机器,大概就类似于《西部世界》或者《底特律》中的机器人,能够在复杂的环境里执行任务。

实现AGI,OpenAI是用大量数据和充分训练来促成大语言模型的“智能涌现”,而DeepMind则选择了“正向教育”——希望通过强化学习,给AI系统以“奖励最大化”的刺激,驱使智能体自主去学习复杂的能力。因为只有表现出这些能力,智能体才能获得奖励(比如生存下去)。

听起来,是不是跟工作犬执行主人的口令,主人根据结果来进行奖励或惩罚是一个路子?

在一篇论文中,DeepMind的研究人员写道:“奖励足以推动智能体表现出通用智能的迹象和行为,包括学习、感知、社会智能、语言、概括和模仿。”

上一只震惊世界的狗是击败人类棋手的“阿尔法狗(AlphaGo)”,而下一只可能就是被DeepMind用强化学习训练出来的AI了。

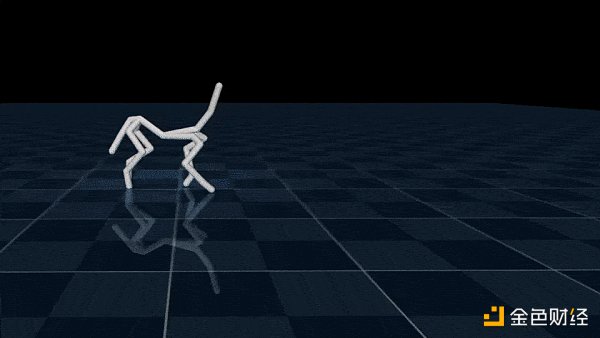

(ANYmal机器人的运动技能是通过模仿狗MoCap来学习的)

比如这只机器狗,就通过强化学习不断试错,从而具备了两个重要的能力:

一是使用历史经验,一般来说电机控制的AI智能体,一开始不知道对每个关节施加什么力,需要大量数据才能迈出步子,不然就会随机抽搐并迅速摔倒,而借助RL可以利用以前学到的运动技能,从而缓解“起步”时的尴尬。

二是减少特殊行为,此前智能机器人一般会用一种很不自然、不够人性化的方式来避障,虽然看起来很有趣,但不够实用。DeepMind采用强化学习训练,偏向于让智能体学习更多的自然行为,可以安全高效地控制真实世界的机器人/机器狗,将机械控制与认知智慧相结合。

类似的强化学习实验还有很多,比如让智能体在网络游戏中展开随机互动,让智能体在模拟的三维世界里搭积木、打扫房间……基本逻辑都是基于人类反馈的奖励模型。

ChatGPT只能解决语言问题,《西部世界》里的人机融合新物种,更灵活的通用家政机器人,可能还真得靠DeepMind的强化学习路线来实现。

像人脑一样思考的AI,够不够有趣?

DeepMind虽然没有跟风推出类ChatGPT的大语言模型,但并不代表它对这个领域毫无建树,只不过二者关注的技术方向不太一样罢了。

随着使用者的增多,大家可能都发现了类ChatGPT模型的一些限制,比如非常注重数据和语料。

深度学习靠规模数据、庞大算力、充分训练而“大力出奇迹”的暴力美学,在大模型时代发挥到了极致。

这带来了一系列问题,比如中文语料不足,训出来的大模型效果不好,有的中文LLM会用英文语料进行训练,再将答案翻译回中文,这种做法当然是符合业界常规的,但问题在于很多价值观、常识性的东西,是没有办法对齐和翻译的。

而且“暴力计算出奇迹”的大炼模型,打造的语言模型是不可解释的黑盒,金融、政务、工业等行业是不敢用的,无法支撑可靠的决策。

不知道OpenAI和国内厂商打算怎么解决“暴力计算”的弊病,反正DeepMind倒是一直在琢磨不同的路线——不搞暴力美学,大搞神经科学。

DeepMind认为大脑才是机器智能模仿的对象,希望通过对脑科学、神经运动学、元学习等“人类本位”的研究,来提升深度学习模型的鲁棒性、可解释性、可靠性等,让AI达到人类水平的理解能力。

比如重新认识大脑的工作机制,借鉴多巴胺通过调节神经元之间突触连接的强度,提出了一种基于奖励的强化学习理论;在3D游戏世界中创建了模拟心理学实验室Psychlab,能够实施经典的心理实验,显著改进了智能体UNREAL的性能;发现在人工神经网络倾向于避开精确设计的代码,倾向于对成本函数进行暴力优化(不追求奖励最大化,而是追求成本最小化,不做错就没有损失),而人脑的机制却往往会专注在任务实现和奖励上,从这个角度去优化深度神经网络的结构。

2023年发表的一篇新论文中,DeepMind则针对大脑中的回放(replay)机制,提出这是一种组合计算的形式,可以衍生出新的知识,在神经网络中整合回放机制,有望让AI用极少的数据学到新东西,提高认知智能,更接近“智能涌现”。

大脑的智慧让人类爬上了万物之灵的宝座,AI不靠人工而靠智能,为什么不可能呢?

当初OpenAI要走NLP这条“冷门”的路,很多人也觉得不可能,直到产品虽不成熟、但能力十分惊艳的ChatGPT出现,人们才开始纷纷夸赞OpenAI的长期主义。这些年DeepMind默默搞的研究,可能就是下一个“王炸”。

我们都希望中国AI也能诞生影响世界的元创新,其实AI领域并没有那么多独门秘技,很多灵感或技术路线都是公开的,但我们为什么总是听过就算、见过就忘呢?

除了灵光一现的idea, OpenAI和DeepMind不断投入的耐心,强大的工程能力,前沿研究与商业化的平衡,也是值得学习和借鉴的。

不能总是热泪盈眶,总是不长记性,直到下一个《震惊!XXX的XXX又颠覆世界了》……

来源于:36氪